Es folgt ein ausführlicher Bericht über die Entwicklung von Tesla mit besonderem Fokus auf die Chip Historie.

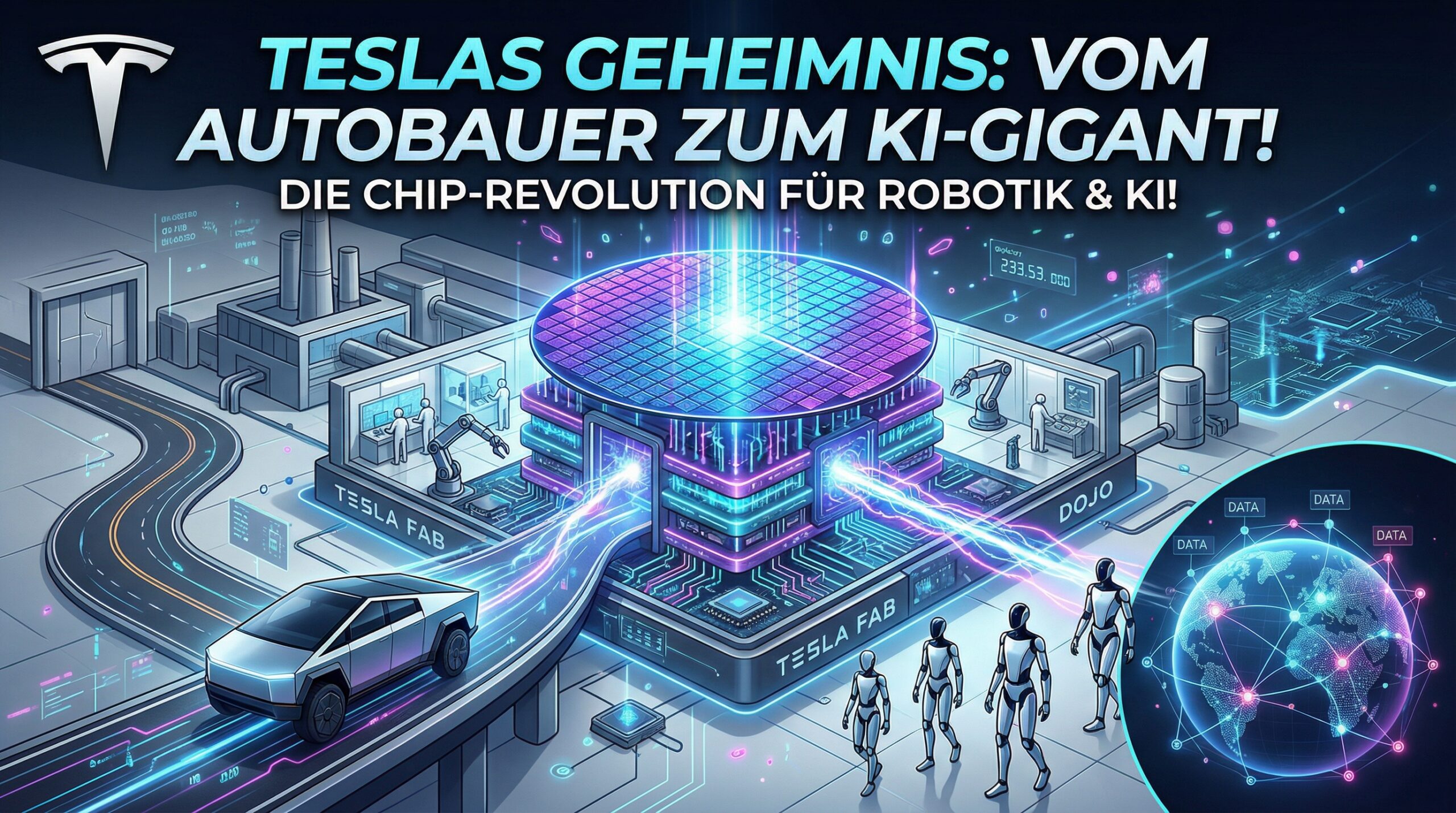

Die Transformation von Tesla von einem reinen Automobilhersteller zu einem vertikal integrierten Technologie- und KI-Konglomerat markiert eine der bedeutendsten Verschiebungen in der modernen Industriegeschichte. Das Herzstück dieser Entwicklung ist die systematische Internalisierung der Halbleiterproduktion und entwicklung. In einer Ära, in der die Verfügbarkeit von Rechenleistung zur strategischen Weltwährung avanciert ist, hat Tesla die Notwendigkeit erkannt, sich von der Abhängigkeit externer Chiphersteller zu emanzipieren, um die Visionen von vollständiger Autonomie, humanoider Robotik und globaler KI-Infrastruktur zu realisieren. Diese Analyse beleuchtet die technologische Evolution, die aktuellen Produktionskapazitäten und die weitreichenden Ambitionen, die Tesla zu einem der bedeutendsten Akteure im Halbleitersektor machen könnten.

Die Evolution der Rechenleistung: Von der Abhängigkeit zur Souveränität

Die Geschichte der Chip-Produktion bei Tesla ist ein Lehrstück über das Streben nach technologischer Autarkie. In der Anfangsphase seiner Bestrebungen im Bereich des autonomen Fahrens war das Unternehmen auf die Expertise etablierter Halbleiterfirmen angewiesen, was jedoch schnell an konzeptionelle und strategische Grenzen stieß.

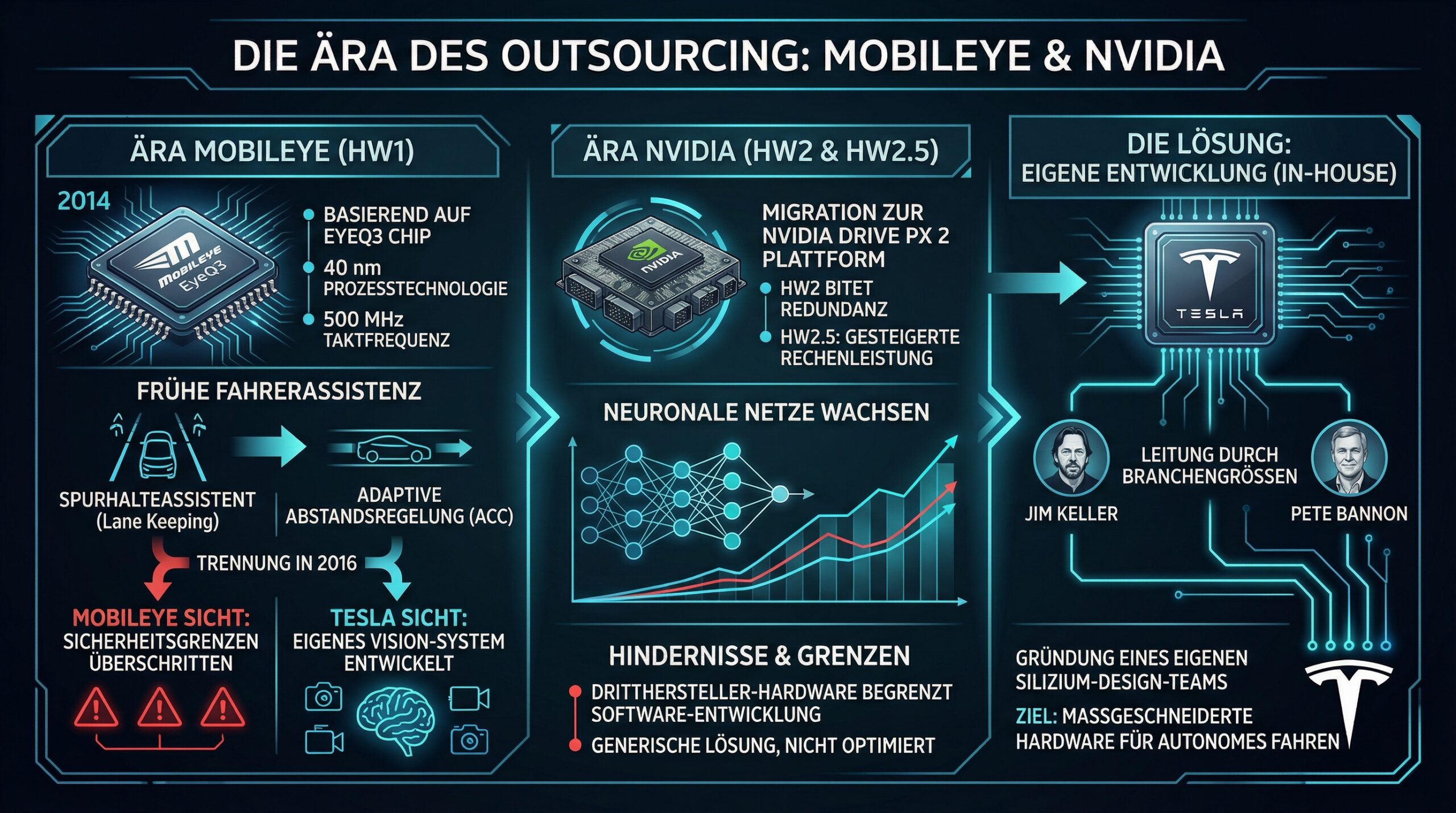

Die Ära der Fremdbeschaffung: Mobileye und NVIDIA

Im Jahr 2014 begann die Ära der Hardware 1 (HW1), die auf dem EyeQ3-Chip von Mobileye basierte. Dieser Chip, gefertigt in einem 40 nm-Verfahren mit einer Taktrate von 500 MHz, ermöglichte erste Fahrerassistenzfunktionen wie den Spurhalteassistenten und die adaptive Geschwindigkeitsregelung. Die Partnerschaft endete 2016 in einem öffentlich ausgetragenen Konflikt. Mobileye behauptete, Tesla habe Sicherheitsgrenzen überschritten, während Tesla entgegnete, Mobileye habe die Zusammenarbeit beendet, nachdem bekannt wurde, dass Tesla an einem eigenen visionsbasierten Sensorsystem arbeitete.

Nach dem Bruch mit Mobileye wechselte Tesla zur Hardware 2 (HW2), die auf der Drive PX 2-Plattform von NVIDIA basierte. Obwohl NVIDIA mit der Einführung von HW2.5 Redundanz und eine gesteigerte Rechenleistung bot, blieb die Hardware eine generische Lösung, die nicht optimal auf die spezifischen Anforderungen von Teslas wachsenden neuronalen Netzwerken zugeschnitten war. Die Erkenntnis, dass die Software-Entwicklung durch die Hardware-Limitierungen von Drittanbietern gebremst wurde, führte zur Entscheidung, ein eigenes Silizium-Designteam aufzubauen, geleitet von Branchengrößen wie Jim Keller und Pete Bannon.

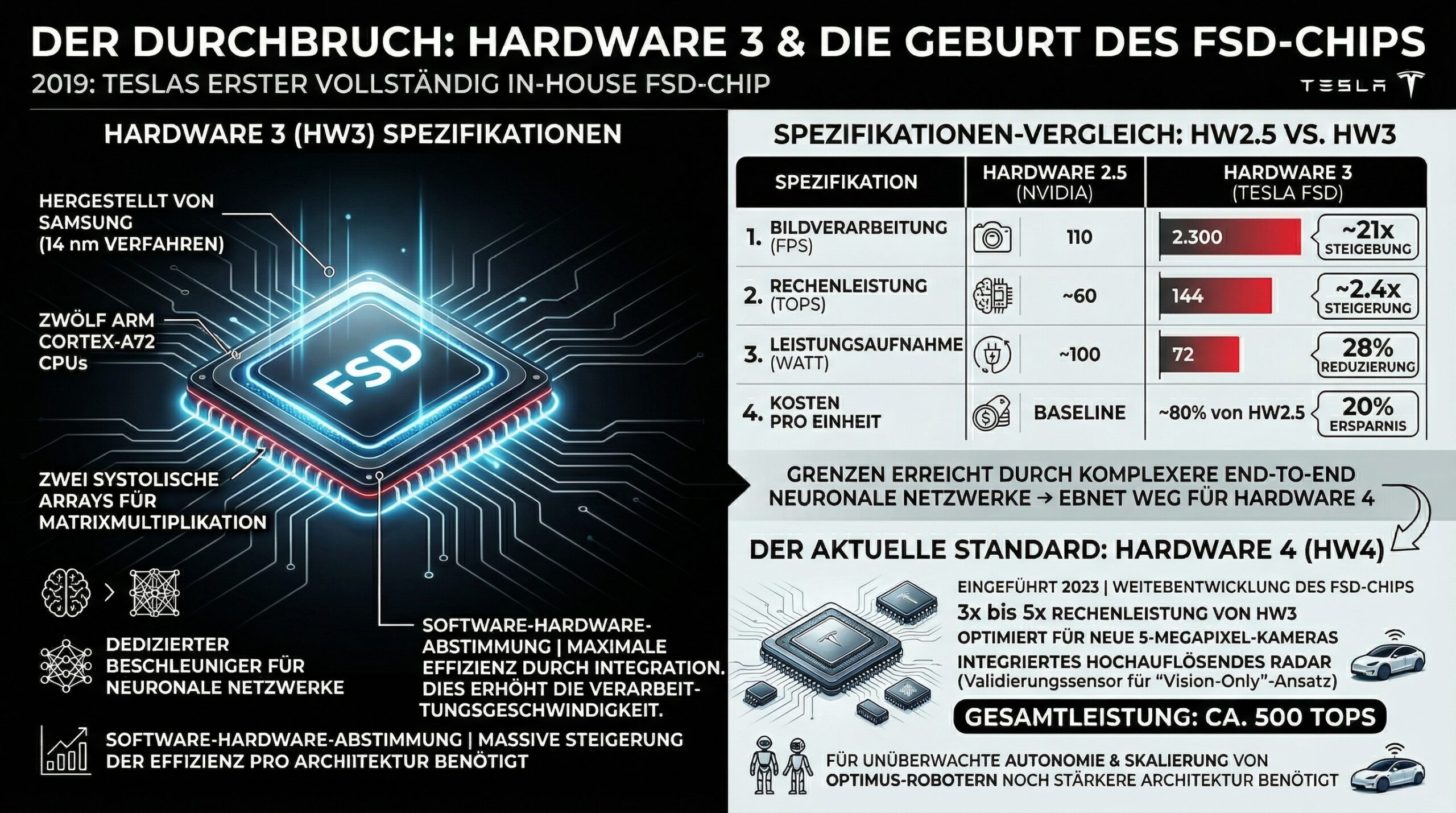

Der Durchbruch: Hardware 3 und die Geburtsstunde des FSD-Chips

Im Jahr 2019 präsentierte Tesla mit der Hardware 3 (HW3) seinen ersten vollständig intern entwickelten “Full Self-Driving” (FSD) Chip. Dieser von Samsung im 14 Nanometer-Verfahren gefertigte Prozessor war als dedizierter Beschleuniger für neuronale Netze konzipiert. Er verfügte über zwölf ARM Cortex-A72 CPUs und zwei systolische Arrays zur Matrixmultiplikation, was eine dramatische Steigerung der Bildverarbeitungsrate ermöglichte.

Der HW3-Chip erlaubte es Tesla erstmals, die gesamte Software-Pipeline auf die Hardware-Architektur abzustimmen, was die Effizienz pro Watt massiv steigerte. Dennoch stießen auch diese Systeme an Grenzen, als die Komplexität der End-to-End-Neuronalen-Netze zunahm, was den Weg für die Hardware 4 (HW4) ebnete.

Der aktuelle Standard: Hardware 4

Eingeführt im Jahr 2023, markierte HW4 eine Evolution des ursprünglichen FSD-Chips. Mit einer drei- bis fünfmal höheren Rechenleistung als HW3 wurde das System darauf optimiert, die Daten von neuen 5-Megapixel-Kameras zu verarbeiten. HW4 integriert zudem ein hochauflösendes Radar, obwohl Tesla weiterhin eine “Vision-only”-Philosophie verfolgt und das Radar primär als Validierungssensor nutzt. Trotz der beeindruckenden Leistung von ca. 500 TOPS wurde deutlich, dass für eine wirklich unsupervised Autonomie und die Skalierung der Optimus-Robotik eine noch leistungsfähigere Architektur erforderlich sein würde.

Die Rolle von Software-Hardware Co-Design

Die Überlegenheit des AI5 resultiert aus der engen Verzahnung von Software und Hardware. Während NVIDIA Chips entwerfen muss, die ein breites Spektrum an Anwendungen von wissenschaftlichen Simulationen bis hin zu LLM-Training abdecken, ist der Tesla AI5 ausschließlich auf Inferenz-Workloads für Vision-Systeme optimiert. Musk betonte, dass der AI5 “weit über sein Gewicht boxt”, da der gesamte Software-Stack darauf ausgelegt ist, jeden Schaltkreis maximal effektiv zu nutzen.

Fertigung und Produktion: Das Streben nach Unabhängigkeit

Ein zentrales Element von Teslas Ambitionen ist die Abkehr vom reinen “Fabless”-Modell hin zu einer stärkeren Kontrolle über den eigentlichen Herstellungsprozess. Angesichts globaler Chip-Engpässe und technologischer Bottlenecks hat Tesla im März 2026 das “Terafab”-Projekt angekündigt.

Das Terafab-Projekt: Eine neue Ära der Fabrikation

Tesla plant den Bau von zwei fortschrittlichen Chip-Fabriken in Austin, Texas, die zusammen als Terafab bezeichnet werden. Dieses Vorhaben wird auf 20 bis 25 Milliarden Dollar geschätzt. Das Ziel ist eine vollständige vertikale Integration, bei der Design, Lithografie, Fertigung, Packaging und Testung unter einem Dach stattfinden.

Die Kapazitätsziele des Terafab-Projekts sind gigantisch:

-

Produktion von Inferenz-Prozessoren: Eine Fabrik wird sich ausschließlich auf Chips für Fahrzeuge und die Optimus-Robotik konzentrieren.

-

Spezialisierte Weltraum-Chips: Die zweite Fabrik wird KI-Chips für Satellitenanwendungen produzieren.

-

Output-Volumen: Musk strebt eine jährliche Rechenkapazität von einem Terawatt an – das Doppelte dessen, was die gesamten USA derzeit produzieren.

Der strategische Vorteil von Terafab liegt in der Geschwindigkeit. Durch den Wegfall des Transports von Wafern zwischen verschiedenen Standorten weltweit will Tesla den branchenüblichen Iterationszyklus von Chips von 6 bis 9 Monaten auf wenige Tage oder Wochen reduzieren. Ein stiller Enabler dieser schnellen Zyklen ist die Partnerschaft mit Synopsys, deren KI-gestützte EDA-Tools (Electronic Design Automation) die Designphase massiv beschleunigen.

Die duale Beschaffungsstrategie: Samsung und TSMC

Obwohl Tesla eigene Fabriken plant, bleibt die Zusammenarbeit mit den Branchenführern Samsung und TSMC kurzfristig essenziell. Für den AI5-Chip verfolgt Tesla eine duale Strategie, um Lieferkettenrisiken zu minimieren und den Wettbewerb zu fördern.

-

Samsung: Das neue Foundry-Werk in Taylor, Texas, wird im März 2026 mit ersten Gerätetests beginnen, um im zweiten Halbjahr 2026 die Massenproduktion des AI5 zu starten. Ein 16,5 Milliarden Dollar schwerer Vertrag sichert zudem die Fertigung der nächsten Generation (AI6) ab 2028.

-

TSMC: Parallel dazu wird TSMC in seinem Werk in Arizona AI5-Chips fertigen. Da TSMC am 2 Nanometer Knoten bis 2028 nahezu ausgebucht ist, bietet Samsung für Tesla eine notwendige Kapazitätsreserve.

Interessanterweise werden sich die von Samsung und TSMC produzierten AI5-Chips physikalisch leicht unterscheiden, da die Unternehmen unterschiedliche Transistordesigns und Verdrahtungsansätze nutzen. Tesla garantiert jedoch, dass die Softwareleistung auf beiden Varianten identisch sein wird.

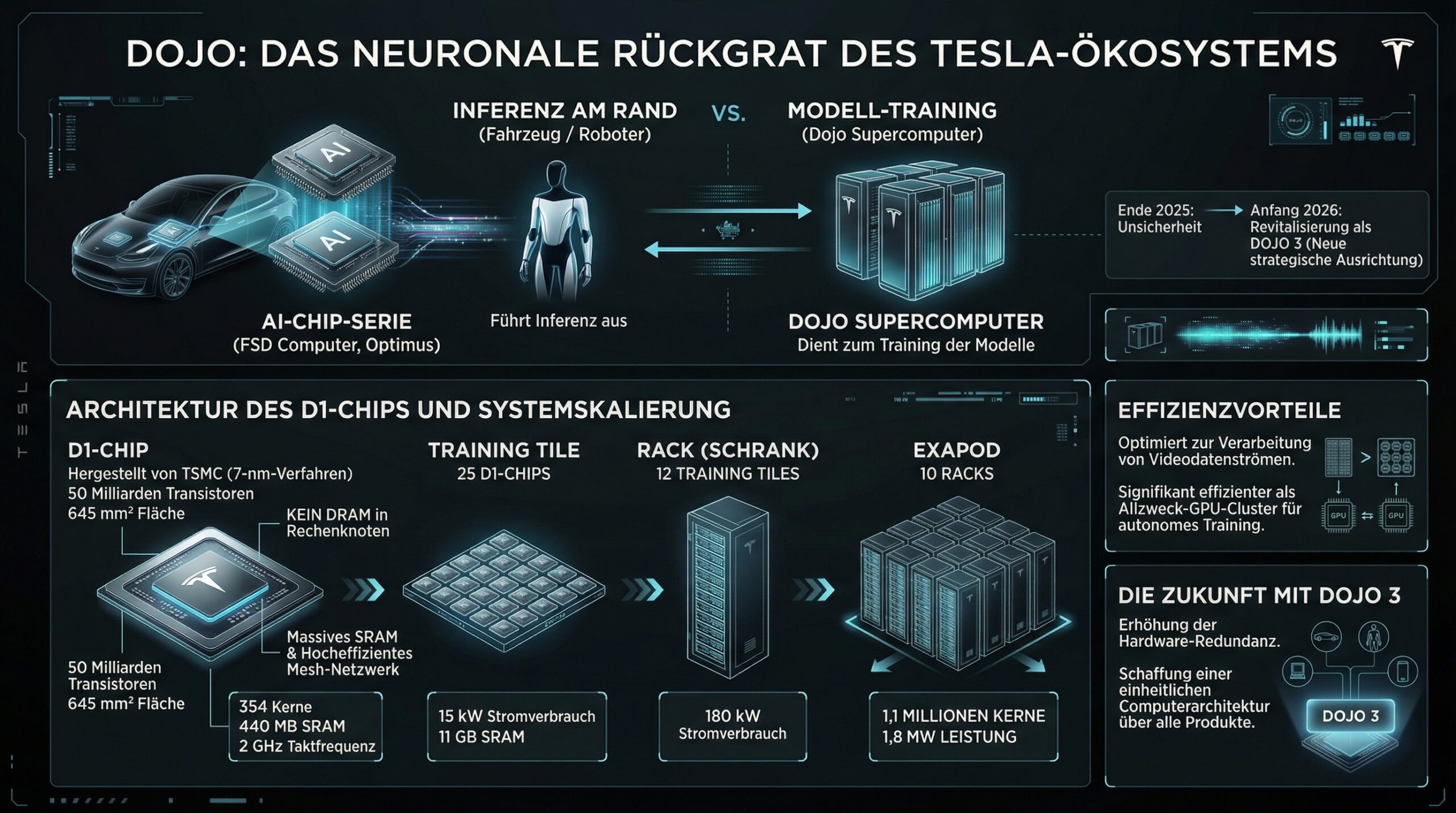

Dojo: Das neuronale Rückgrat des Tesla-Ökosystems

Während die AI-Chip-Serie für die Inferenz “am Edge” (im Fahrzeug oder Roboter) zuständig ist, dient der Dojo-Supercomputer dem Training der Modelle. Nach einer Phase der Unsicherheit Ende 2025 wurde das Projekt Anfang 2026 unter der Bezeichnung Dojo 3 mit einer neuen strategischen Ausrichtung wiederbelebt.

Architektur des D1-Chips und System-Skalierung

Der D1-Chip, das Fundament von Dojo, wird von TSMC im 7-nm-Verfahren hergestellt. Auf einer Fläche von 645 mm beherbergt er 50 Milliarden Transistoren. Das Besondere an der Dojo-Architektur ist das Fehlen von DRAM direkt in den Rechenknoten; stattdessen setzt das System auf massives SRAM und ein hocheffizientes Mesh-Netzwerk.

Dojo ist darauf optimiert, Video-Datenströme zu verarbeiten, was es deutlich effizienter für das Training von autonomen Systemen macht als Allzweck-GPU-Cluster. Mit der Wiederaufnahme der Arbeit an Dojo 3 plant Tesla, die Hardware-Redundanz zu erhöhen und eine einheitliche Rechenarchitektur über alle Produkte hinweg zu schaffen.

Die Vision des orbitalen Computing

Ein radikaler neuer Ansatz für Dojo 3 ist die Verlagerung des KI-Trainings in den Weltraum. Musk argumentiert, dass orbitale Rechenzentren thermische und energetische Vorteile bieten könnten. Im Vakuum des Weltraums ist das Wärmemanagement zwar eine Herausforderung (Erfordernis massiver Radiatoren), doch die Verfügbarkeit von konstanter, intensiver Solarenergie macht Batterien überflüssig und entlastet die terrestrischen Stromnetze. Dieses Projekt wird in enger Synergie mit SpaceX und dessen Starlink-Konstellation entwickelt.

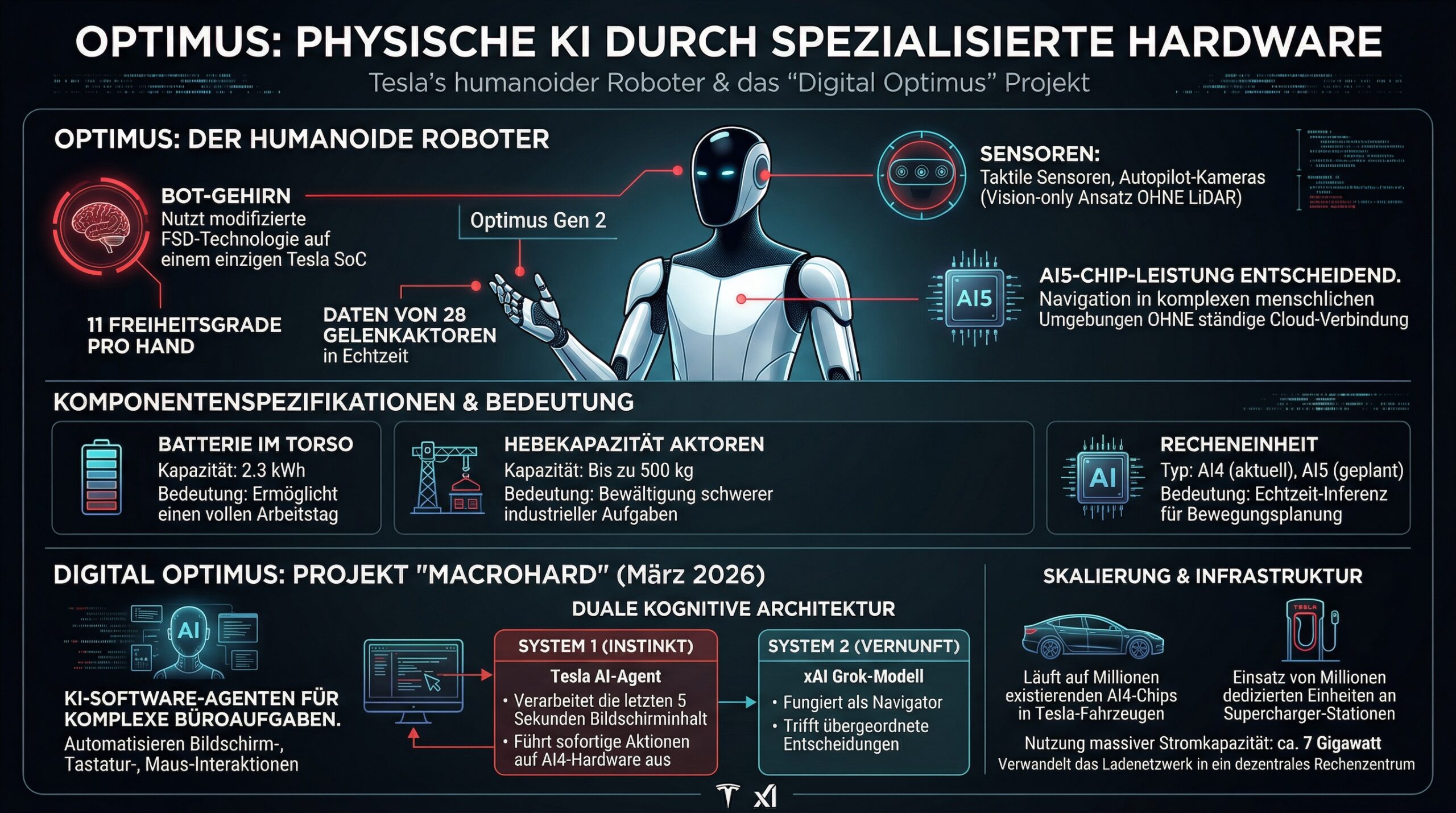

Optimus: Physische KI durch spezialisierte Hardware

Der humanoide Roboter Optimus nutzt eine modifizierte Version der FSD-Technologie, die auf einem einzigen Tesla SoC (“Bot Brain”) läuft. Dieses System verarbeitet Daten von 28 Gelenk-Aktuatoren und 11 Freiheitsgraden pro Hand in Echtzeit. Die Leistungsfähigkeit des AI5-Chips ist für Optimus entscheidend, um in komplexen menschlichen Umgebungen ohne ständige Cloud-Anbindung navigieren zu können.

Digital Optimus (Macrohard)

Im März 2026 kündigten Tesla und xAI das Projekt “Digital Optimus” an, auch bekannt unter dem Namen “Macrohard”. Hierbei handelt es sich um KI-Software-Agenten, die darauf trainiert sind, komplexe Büroabläufe zu automatisieren, indem sie wie Menschen mit Computerbildschirmen, Tastaturen und Mäusen interagieren.

Das System nutzt eine duale kognitive Architektur:

-

System 1 (Instinkt): Ein Tesla-KI-Agent verarbeitet die letzten 5 Sekunden des Bildschirminhalts und führt sofortige Aktionen auf der AI4-Hardware aus.

-

System 2 (Vernunft): Das Grok-Modell von xAI fungiert als Navigator und trifft übergeordnete Entscheidungen.

Digital Optimus soll auf den Millionen bereits existierenden AI4-Chips in Tesla-Fahrzeugen laufen. Musk plant zudem den Einsatz von Millionen dedizierter Einheiten an Supercharger-Stationen, um deren massive Stromkapazität von ca. 7 Gigawatt für KI-Berechnungen zu nutzen. Dies transformiert das Ladenetzwerk effektiv in ein dezentrales Rechenzentrum.

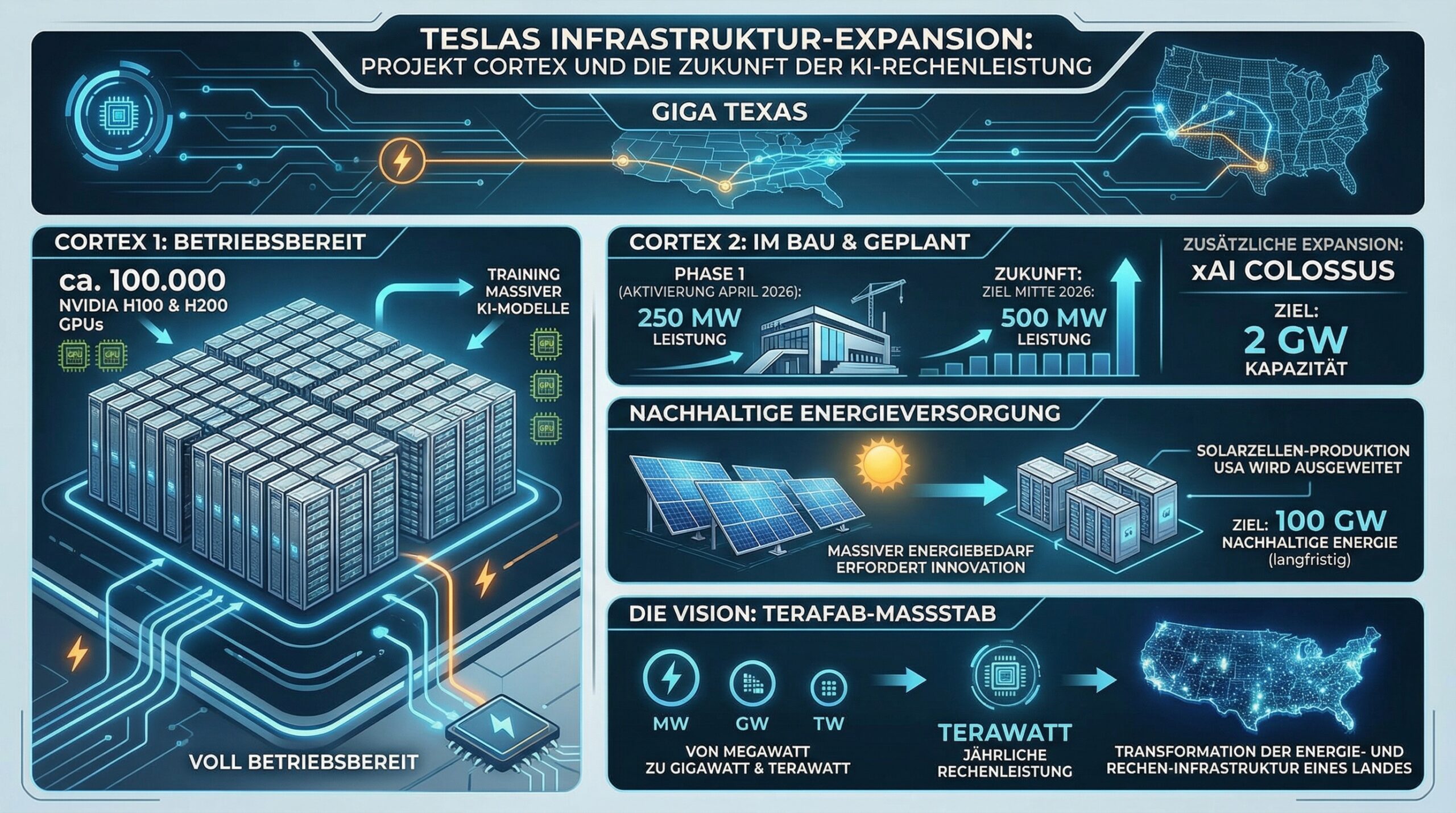

Infrastruktur-Skalierung: Cortex und die Gigawatt-Zukunft

Um das Training dieser massiven Modelle zu unterstützen, baut Tesla seine Infrastruktur in Giga Texas unter dem Projektnamen Cortex rasant aus.

Cortex 1 und Cortex 2

Cortex 1 ist bereits in Betrieb und nutzt etwa 100.000 NVIDIA H100 und H200 GPUs. Cortex 2 befindet sich im Bau und wird in der ersten Phase im April 2026 eine Leistung von 250 MW erreichen, mit einer Zielkapazität von 500 MW bis Mitte 2026.

Der massive Strombedarf dieser Anlagen erfordert innovative Lösungen. Tesla plant eine Expansion der US-Solarzellenproduktion, um die für die Rechenzentren benötigten 100 Gigawatt Leistung langfristig nachhaltig zu decken. Ein Terawatt an jährlicher Rechenleistung, wie es für Terafab geplant ist, verdeutlicht die Dimensionen, in denen Tesla denkt: Es geht nicht mehr um Megawatt, sondern um den Umbau der gesamten Energie- und Recheninfrastruktur eines Landes.

Wettbewerbsanalyse und strategische Implikationen

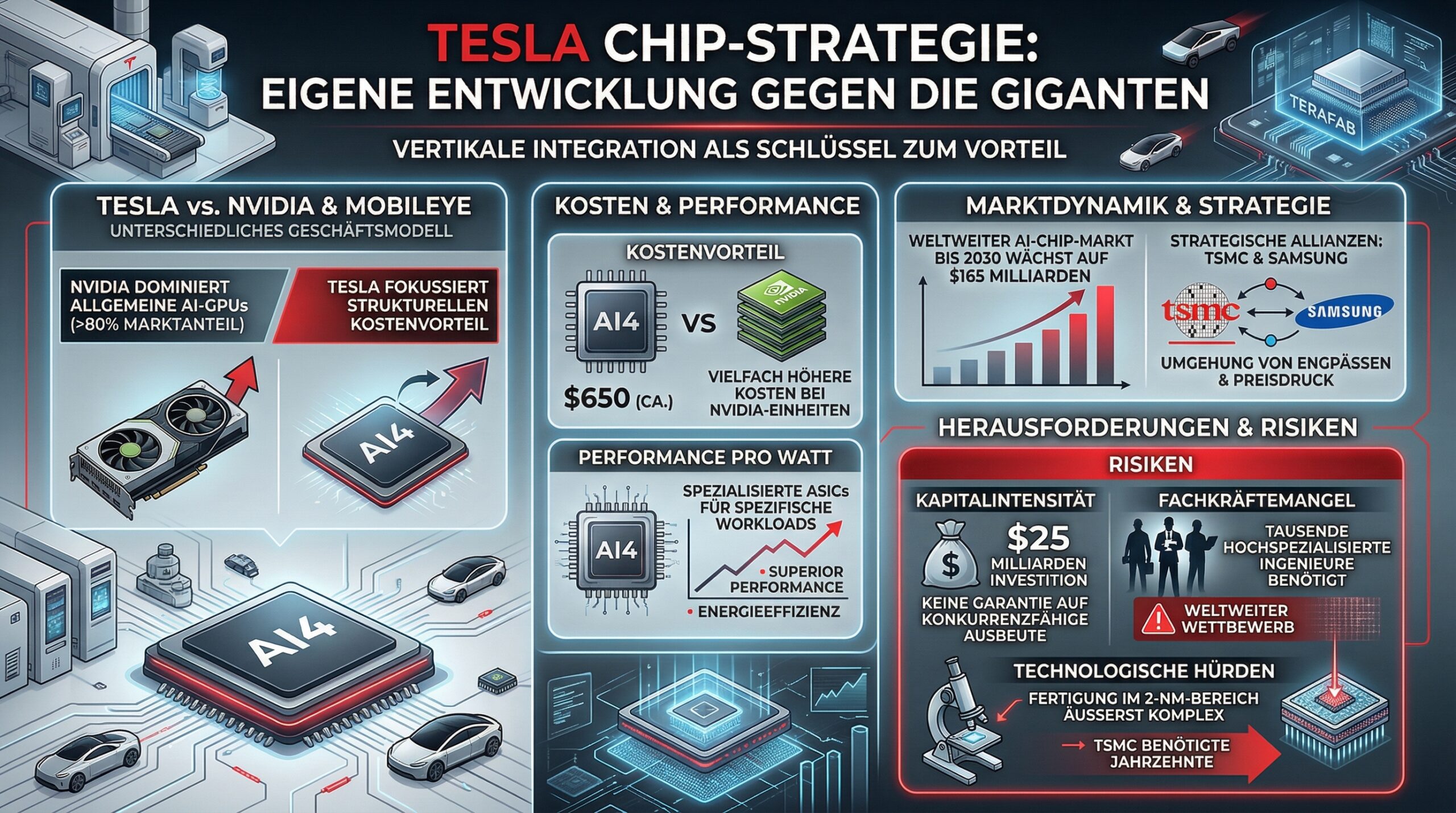

Die Entwicklung eigener Chips platziert Tesla in direkter Konkurrenz zu etablierten Größen wie NVIDIA und Mobileye, jedoch mit einem fundamental anderen Geschäftsmodell.

Tesla vs. NVIDIA

Während NVIDIA den Markt für Allzweck-KI-GPUs mit einem Marktanteil von über 80% dominiert, zielt Tesla darauf ab, durch vertikale Integration einen strukturellen Kostenvorteil zu erlangen. Die Kosten für einen AI4-Chip liegen bei ca. 650$, während eine vergleichbare NVIDIA-Einheit ein Vielfaches kostet. Durch das Design spezialisierter ASICs (Application-Specific Integrated Circuits) erreicht Tesla eine überlegene Performance-pro-Watt für seine spezifischen Workloads.

Marktdynamik und Risiken

Der globale Markt für KI-Chips wird bis 2030 voraussichtlich auf 165$ Milliarden Dollar anwachsen. Teslas Entscheidung, sowohl TSMC als auch Samsung zu nutzen, ist ein strategischer Schachzug, um die bei TSMC herrschende Knappheit zu umgehen und Preisdruck auszuüben.

Allerdings birgt der Einstieg in die Chip-Fertigung (Terafab) enorme Risiken:

-

Kapitalintensität: 25$ Milliarden Dollar Investment ohne Garantie auf wettbewerbsfähige Yield-Raten.

-

Fachkräftemangel: Die Halbleiterfertigung erfordert Tausende hochspezialisierter Ingenieure, die weltweit umkämpft sind.

-

Technologische Hürden: Die Fertigung am 2 Nanometer-Knoten ist eine der komplexesten Aufgaben der Menschheit; TSMC hat Jahrzehnte gebraucht, um dieses Niveau zu erreichen.

Schlussfolgerung und Ausblick

Teslas Engagement im Bereich der Chip-Produktion ist weit mehr als eine Optimierungsmaßnahme für seine Fahrzeuge. Es ist der Versuch, die technologische Kontrolle über die gesamte Wertschöpfungskette der künstlichen Intelligenz zu erlangen. Mit dem AI5-Chip steht das Unternehmen an der Schwelle zur unsupervised Autonomie, während Projekte wie Terafab und die orbitalen Dojo-Rechenzentren eine Vision von “nachhaltigem Überfluss” zeichnen, in der menschliche Arbeit durch KI und Robotik ergänzt oder ersetzt wird.

Die Roadmap für 2026 bis 2028 sieht eine extrem aggressive Iterationsrate von neuen Chip-Designs alle 9 Monate vor. Sollte es Tesla gelingen, die technologischen Herausforderungen der Eigenfertigung zu meistern, könnte das Unternehmen nicht nur den Automobilmarkt, sondern die gesamte Halbleiterindustrie disruptieren. Die Kombination aus massiven Flottendaten, spezialisierter Hardware und einer beispiellosen Recheninfrastruktur schafft einen Burggraben, der für Konkurrenten ohne ähnliche vertikale Integration nur schwer zu überwinden sein wird. Tesla entwickelt sich von einem Hersteller von Hardware-Produkten zu einem Anbieter von universeller Intelligenz, wobei das Silizium das unverzichtbare Fundament dieser neuen industriellen Realität darstellt.

Vielen Dank für Ihr Interesse, die Grafiken wurden mit Hilfe von Nano Banana erstellt.

Und das sind die Themen der 29. Ausgabe:

- Neues aus der Tesla Welt

- Ende der unrühmlichen FSD-Geschichte: Hoffnung auch für ältere Teslas

- Der unboxed Process bei Tesla: Fahrzeug Produktion neu gedacht

- Nachhaltig unterwegs: Mit Tesla Model und BlaBlaCar gegen gängige Mythen

- Die Herausgeber: Tesla Fahrer und Freunde E.V.

- Die Herausgeber: Swiss Tesla Days: Das Schweizer Highlight für die Tesla-Community

- Elektrische Community 2026

- Strombock: Elektroauto-Förderung 2026: Wie nutzt du die Förderung für dich?

- Der Pommes-Män im Gespräch: Jenseits der Fritteuse

- Der Berg im Nebel: Zur Strategie der Automobilindustrie

- Mobilität: Warum autonomes Fahren alles verändert

- Außerirdische Intelligenz: KI im Weltall

- Nachhaltigkeit: Die Quadratur des Dreiecks

- Osmose-Kraftwerk: Salzkraft

- Klimaschutz: Eskalation im Klimawandel

- Fanboy: Grok im Tesla

Für diesen Bericht verwendete Quellen:

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet

Wird in einem neuen Fenster geöffnet